Elasticsearch數據存儲流程圖解析 數據處理與存儲服務全流程

一、數據流入與預處理階段

1. 數據采集與接收

- 數據通過Logstash、Beats、API接口、Kafka消息隊列等多種渠道流入

- 支持JSON、CSV、日志文本等多種數據格式

- 數據接收服務進行初步的格式驗證和異常檢測

2. 數據解析與轉換

- 使用Ingest Pipeline進行實時數據處理

- 字段提取:從原始數據中提取結構化字段

- 數據清洗:去除無效字符、標準化日期格式

- 字段映射:建立字段與數據類型的對應關系

- 數據豐富:添加地理信息、用戶標簽等附加數據

二、核心存儲處理流程

3. 索引創建與映射

- 根據mapping配置自動或手動創建索引

- 定義字段類型:文本、數值、日期、地理坐標等

- 設置分析器:指定分詞規則和搜索優化參數

- 配置副本和分片策略:確定數據分布和冗余方案

4. 文檔處理流程`

原始文檔 → 分詞處理 → 倒排索引構建 → Lucene段文件

↓

詞項字典建立

↓

位置信息存儲

↓

文檔ID映射`

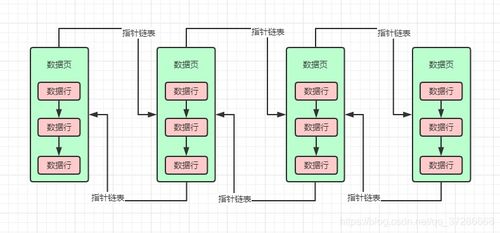

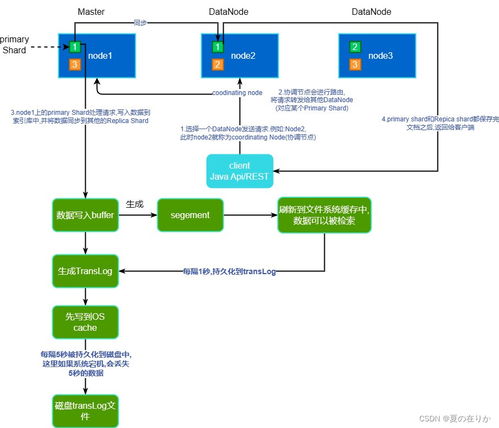

5. 分布式存儲機制

- 分片(Sharding)策略:

- 主分片:負責數據的寫入和存儲

- 副本分片:提供數據冗余和高可用性

- 默認配置:5個主分片 + 1個副本分片

- 節點角色分配:

- 數據節點:存儲索引數據

- 主節點:集群管理

- 協調節點:請求路由

- 預處理節點:運行Ingest Pipeline

三、存儲優化與持久化

6. 寫入流程優化

- 緩沖機制:使用內存緩沖區暫存寫入請求

- 事務日志(Translog):確保數據的持久性和一致性

- 刷新(Refresh)操作:定期將內存數據轉為可搜索狀態

- 刷盤(Flush)操作:將數據持久化到磁盤

7. 段文件管理

- 段合并(Merge):將多個小段合并為更大段

- 段優化:刪除已標記刪除的文檔

- 壓縮存儲:減少磁盤空間占用

四、數據生命周期管理

8. 索引生命周期策略(ILM)`

熱階段(Hot) → 溫階段(Warm) → 冷階段(Cold) → 刪除階段(Delete)

↓ ↓ ↓ ↓

高頻讀寫 中頻訪問 低頻訪問 數據清理

↓ ↓ ↓

SSD存儲 HDD存儲 歸檔存儲`

9. 快照與恢復

- 定期創建集群快照

- 支持增量備份

- 快速災難恢復能力

- 跨集群數據遷移

五、監控與維護

10. 存儲監控指標

- 磁盤使用率

- 索引大小增長趨勢

- 段文件數量和大小

- 緩存命中率

- 寫入吞吐量和延遲

11. 存儲優化建議

- 根據數據特性選擇合適的分片大小

- 合理設置刷新間隔

- 使用合適的壓縮算法

- 定期清理過期索引

- 監控熱點分片的分布

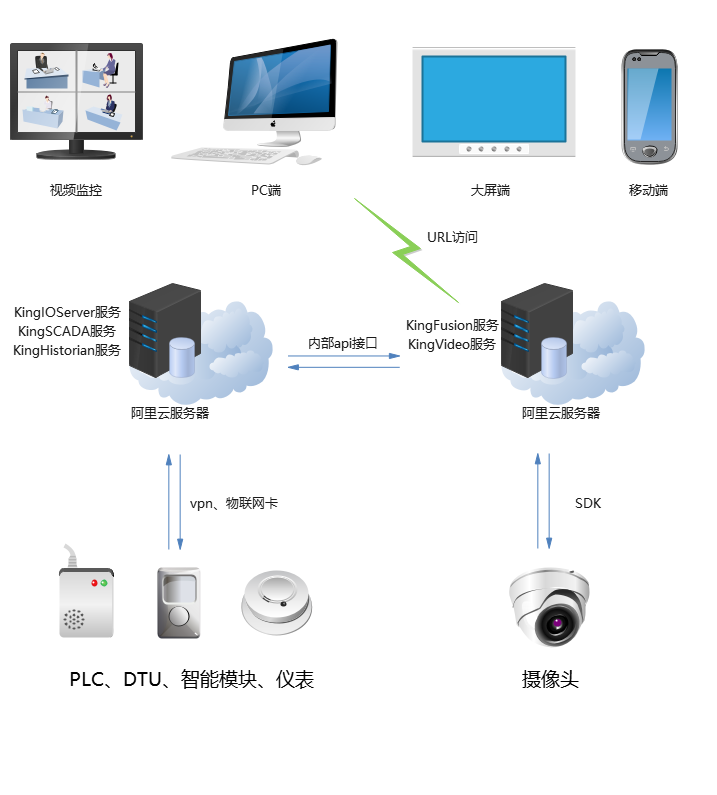

六、數據處理服務集成

12. 與其他服務協同

- Kibana:數據可視化和儀表板

- Logstash:數據采集和預處理

- Beats:輕量級數據采集器

- 機器學習服務:異常檢測和預測分析

13. 數據安全與權限控制

- 基于角色的訪問控制(RBAC)

- 字段級安全控制

- 數據傳輸加密

- 審計日志記錄

##

Elasticsearch的數據存儲流程是一個高度優化的分布式系統,從數據流入、處理、存儲到生命周期管理,每個環節都經過精心設計。理解這個流程有助于:

- 合理規劃集群架構

- 優化數據存儲性能

- 確保數據安全可靠

- 降低運維成本

- 提升查詢效率

通過流程圖可以清晰地看到,數據處理和存儲服務在Elasticsearch中形成了一個完整閉環,確保海量數據能夠高效、穩定、安全地存儲和檢索。

如若轉載,請注明出處:http://www.cuspa.org.cn/product/54.html

更新時間:2026-04-12 05:59:12